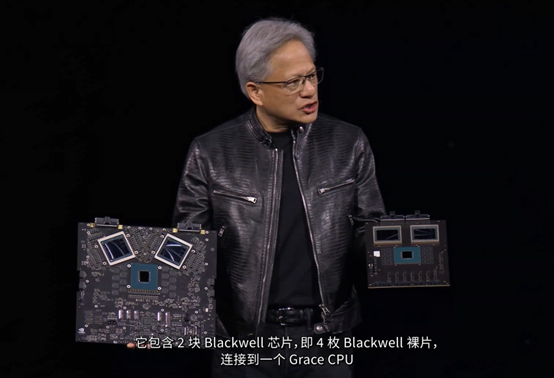

英伟达财报电话会,CFO现场算“投入产出比”:每一美元投入GPU,未来四年可以赚5美元!

在GPU上每花费1美元,云提供商就有机会在4年内获得5美元的托管收入。在HGX H200 服务器上每花费 1 美元,托管Llama 3服务的 API 提供商就能在 4 年内获得 7 美元的收入。

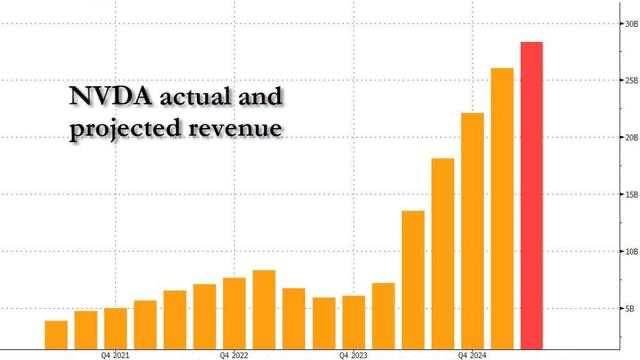

隔夜,“地球上最重要的股票”、标普第三大权重股英伟达公布2024财年一季度财报。财报显示,上季度英伟达总营收和数据中心收入连续多个季度创新高,分别同比增长262%和427%,远远超出华尔街预期。

在随后的电话会议上,首席财务官科莱特·克雷斯为分析师们算了一笔账,强调在如今火热的行情下,购买英伟达的芯片,很快就能收回成本。

克雷斯表示,数据中心业务的强劲增长得益于来自企业和互联网公司的需求激增。她着重强调了云计算租赁市场的重要性,认为云服务可助力客户收回采购英伟达芯片的部分成本。她预计,每花费1美元采购英伟达人工智能基础设施,云提供商在未来四年内就有机会通过提供算力服务(GAAS)赚取5美元收入。

克雷斯重申,英伟达为云端客户提供“最快的模型训练速度、最低的训练成本和最低的大型语言模型推理成本”。她透露,目前公司的客户包括OpenAI、Anthropic、DeepMind、Elon Musk的xAI、Cohere、Meta和Mistral等知名人工智能公司。

值得关注的是,克雷斯还分享了英伟达与特斯拉的密切合作。特斯拉为进行AI训练,总共囤积了3.5万块H100 GPU,克里斯预计,今年汽车将成为英伟达数据中心业务中最大的企业垂直领域,带来数十亿美元的收入机会。

她还表示,Meta的Llama3大型语言模型是在2.4万块英伟达H100 GPU上训练的;上周OpenAI展示的GPT-4o由英伟达H200芯片提供算力支持,H200推理性能比H100高出近一倍。

克雷斯以Llama3为例,解释了人工智能公司如何从提供API服务中获利。她表示:

对7000亿参数级别的Llama3模型,一台英伟达HGX H200服务器每秒可输出2.4万个token,同时为2400多个用户提供服务。这意味着,托管Llama3的API供应商每花费1美元在英伟达HGX H200服务器上,未来四年内就可从Llama3 token计费中赚取7美元收入。

财报发布后,英伟达盘后股价飙升6%,突破1000美元关口,市值2.3万亿美元,稳居标普成分股第三位。